{{!completeInfo?'请完善个人信息':''}}

扬帆创投微信小程序

更聚焦的出海投融资平台

精准高效领先的融资对接服务

精准高效领先的融资对接服务

微信扫一扫进入小程序

AI手机的时代真的来了吗?

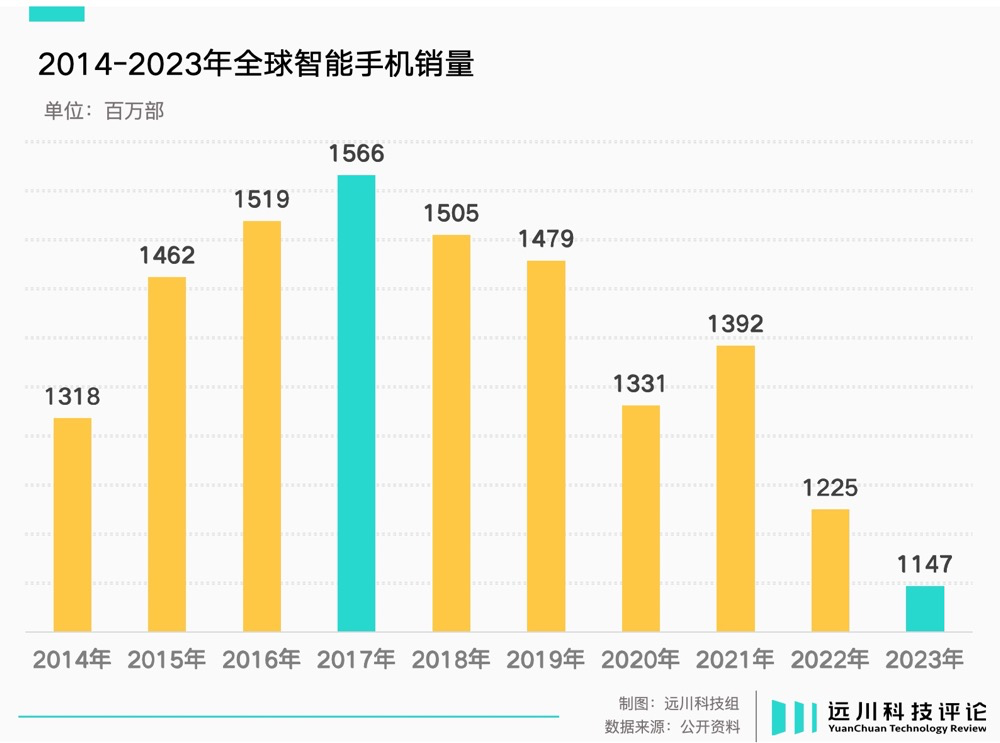

冷饭新炒

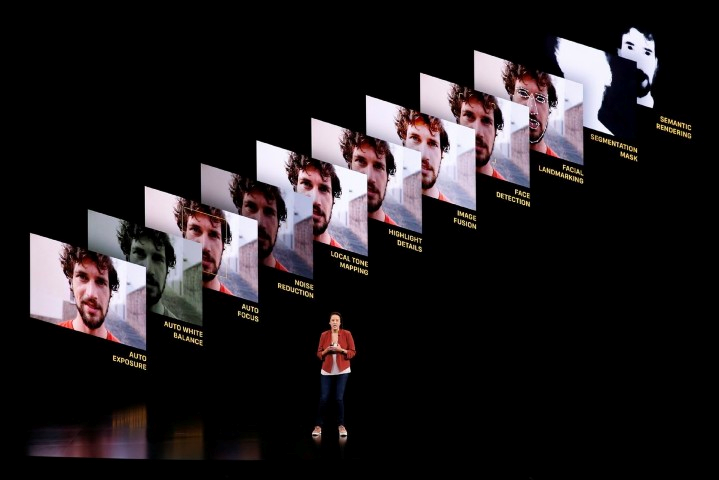

颠覆式体验

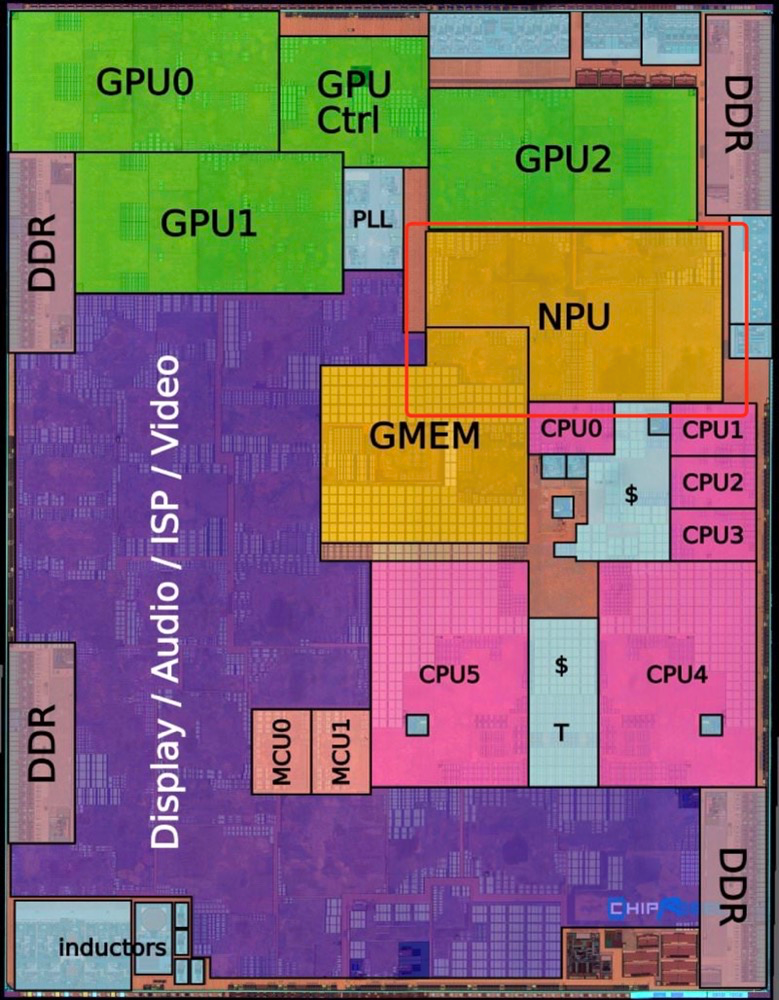

什么困住了AI手机?

尾声

文章作者:何律衡

版权申明:文章来源于远川科技评论。该文观点仅代表作者本人,扬帆出海平台仅提供信息存储空间服务,不代表扬帆出海官方立场。因本文所引起的纠纷和损失扬帆出海均不承担侵权行为的连带责任,如若转载请联系原文作者。 更多资讯关注扬帆出海官网:https://www.yfchuhai.com/

{{likeNum}}

好文章,需要你的鼓励

已关注

已关注

关注

关注

请前往扬帆出海小程序完成个人认证

认证通过后即可申请入驻

咨询/开通企业服务会员

请添加下方商务企业微信

请添加下方商务企业微信

企业服务会员

助力销售转化再上台阶

bd@yfchuhai.com

助力销售转化再上台阶

bd@yfchuhai.com

咨询/开通企业服务会员

请添加下方商务企业微信

请添加下方商务企业微信

企业服务会员

助力销售转化再上台阶

bd@yfchuhai.com

助力销售转化再上台阶

bd@yfchuhai.com

APP

小程序

小程序

微信小程序

扬帆出海APP

微信

公众号

公众号

关注扬帆出海

专注服务互联网出海!

出海人

社群

社群

扫码进群

与10万+出海人同行!

您还未完善信息,请先完善信息在发布

去完善

{{imgUrlTip}}